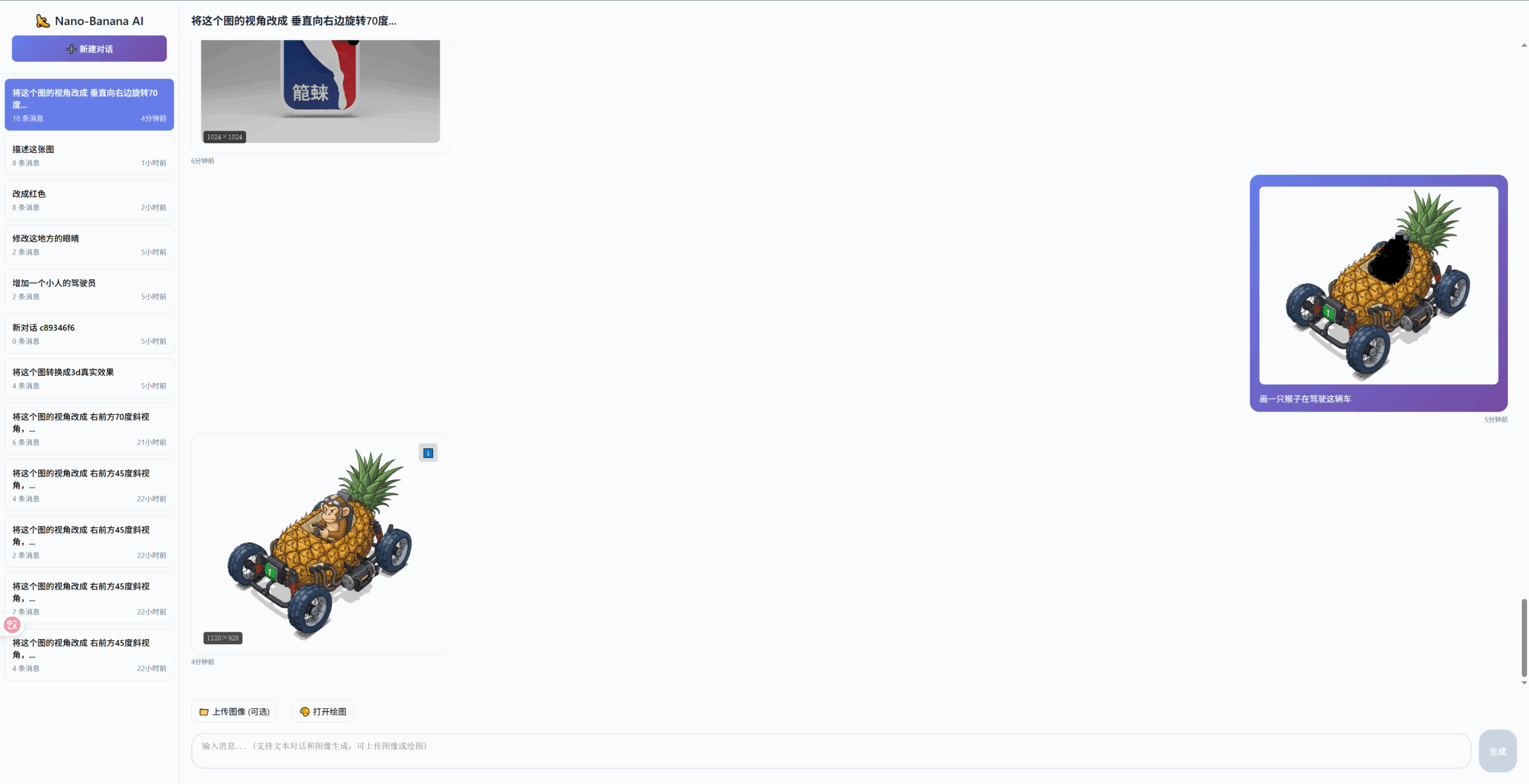

在我的工作中,缺个能够完全支持中文的同时具备文生图能力的高品质模型。在了解到Qwen模型能够通过中文达到指向性的修改的能力,所以在这做一波测试效果对比。我对比的是字节的即梦模型,它在游戏行业 中logo、海报、美术字、场景、人像角色泛化能力算是比较强的。接下来会划分几个维度看看他们的能力处在一个什么样的边界。

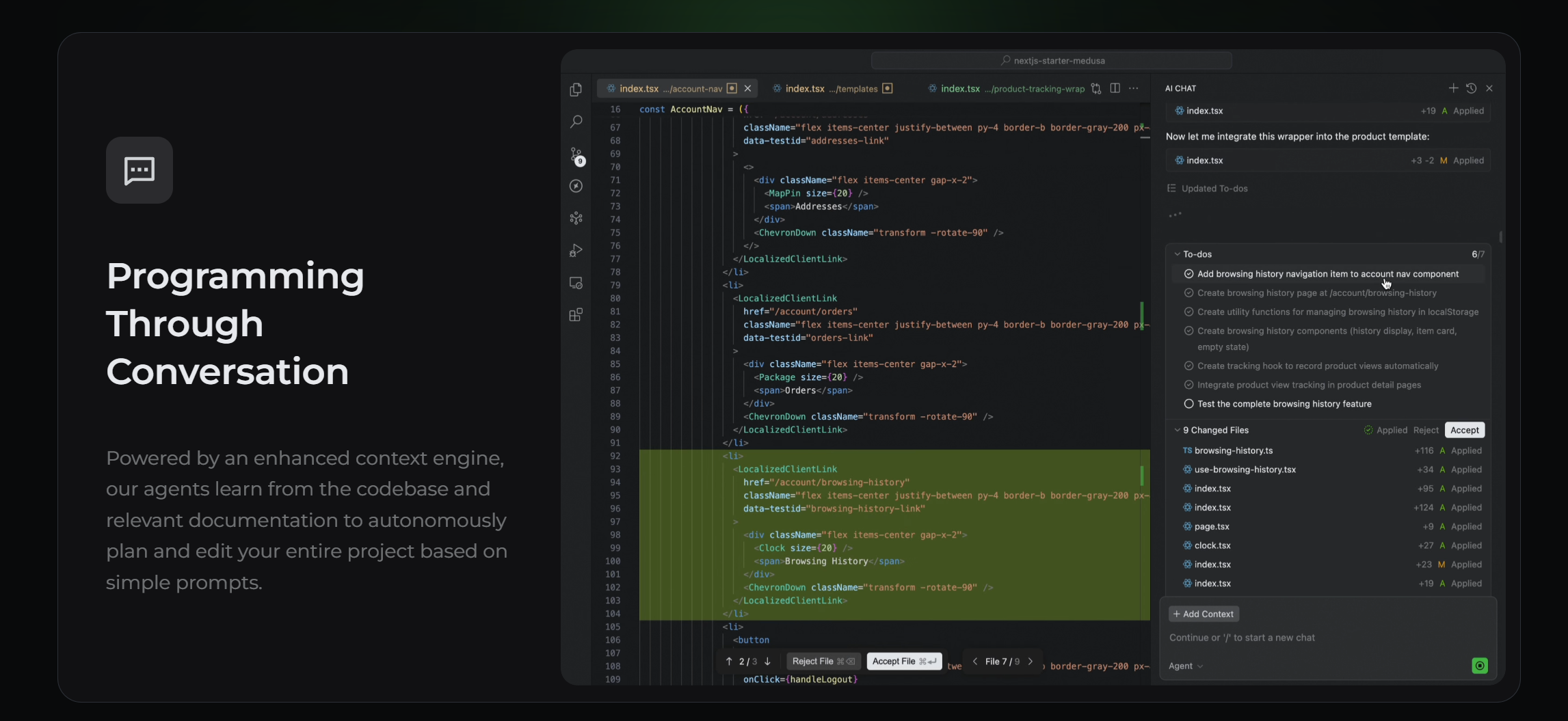

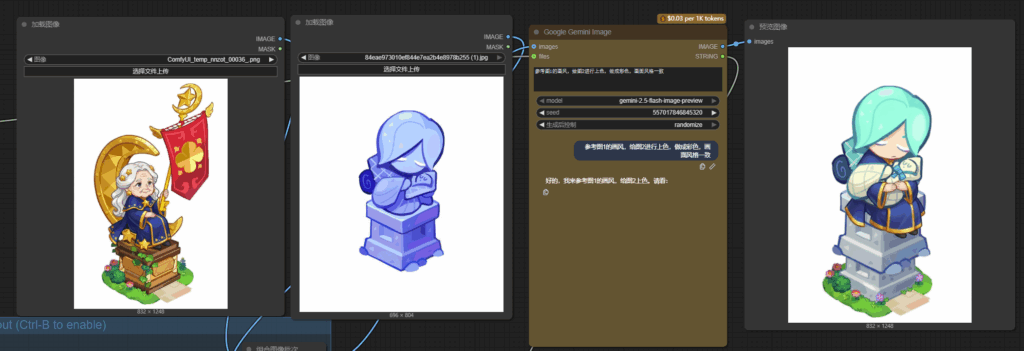

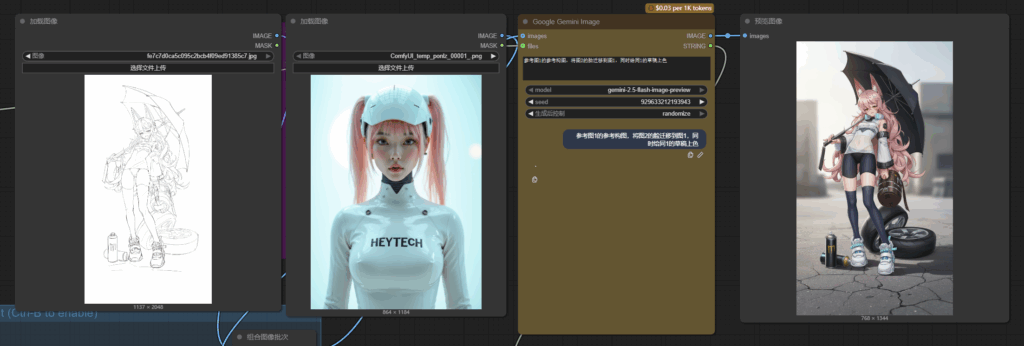

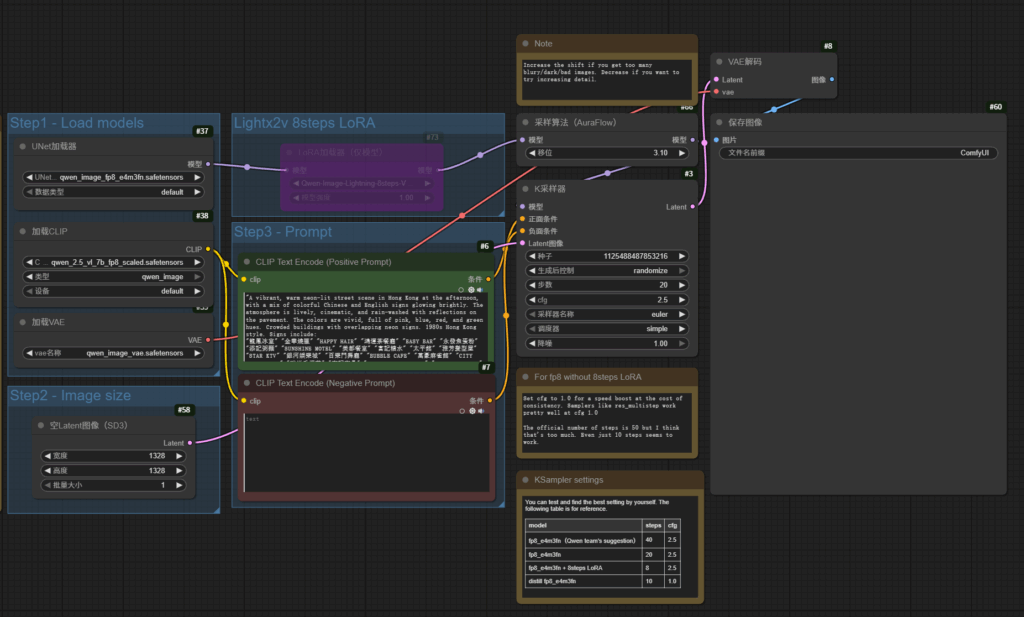

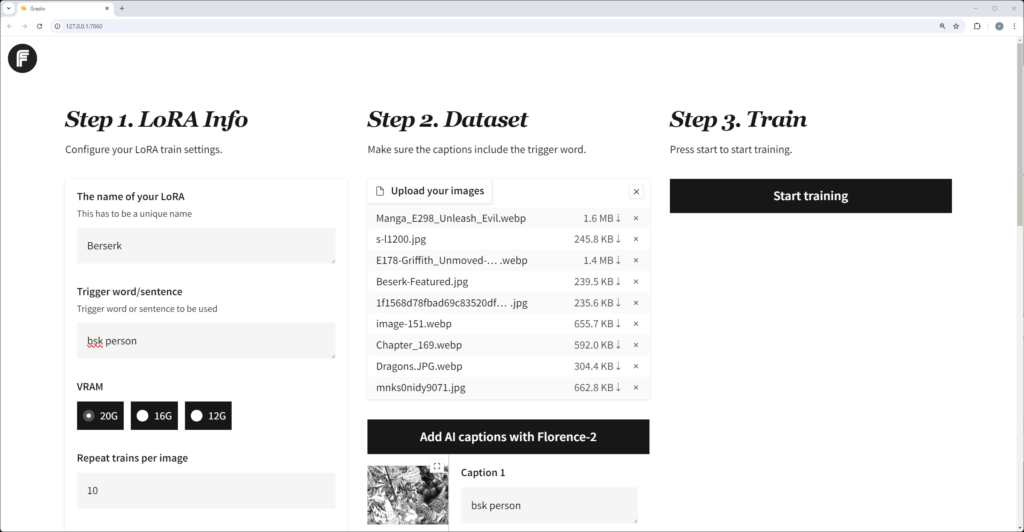

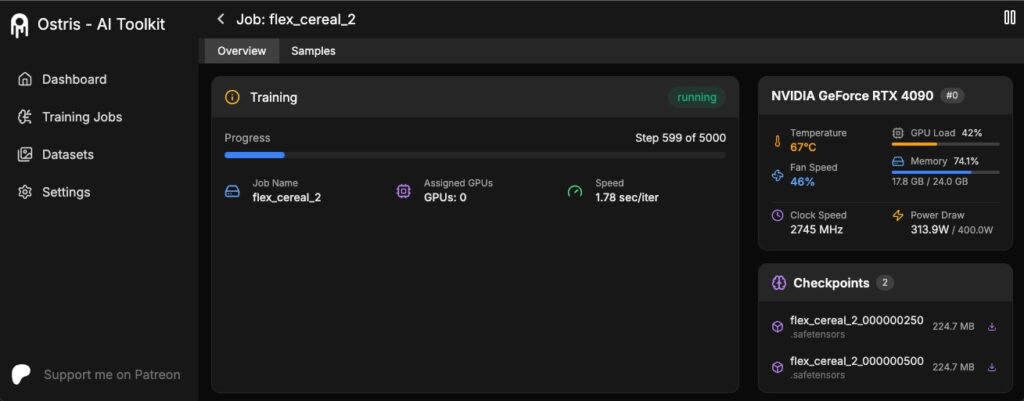

Qwen-image 工作流

注:以下效果图左边是即梦,右边是Qwen 。本次测试的Qwen模型为20g大小的精简 版 。即梦为3.0 。

游戏道具图标测试效果:

厚涂中国风,游戏图标,仙侠法宝,玄幻色彩,九宫格显示9个造型各异的宝箱道具图标,设计精良,细节丰富,充满金属光泽,高档,闪亮,发光,色彩鲜艳明亮,多种材质,镶嵌宝石,金色花纹装饰,散发着神秘的光芒,纯色背景,正面斜45度视角,色彩简洁明快,奇幻插画风格,大师作品

宝箱设计风格的一致性不错,角度也一致,唯独两者在细节花纹上都需要二次修正。

icon图标设计,一共九个,图标顺序依次是:汉堡,薯条,炸鸡,可乐,鸡肉卷,奶茶,面条,米饭,包子,3D,立体感,颜色统一,白色背景,光影质感

这组图标,两者总体风格是一致的,但是在细节效果上即梦完善的更好,造型美观度要比Qwen好,体现在鸡腿的造型和细节,可口可乐的易拉罐会更有辨识度。

点击可查看大图

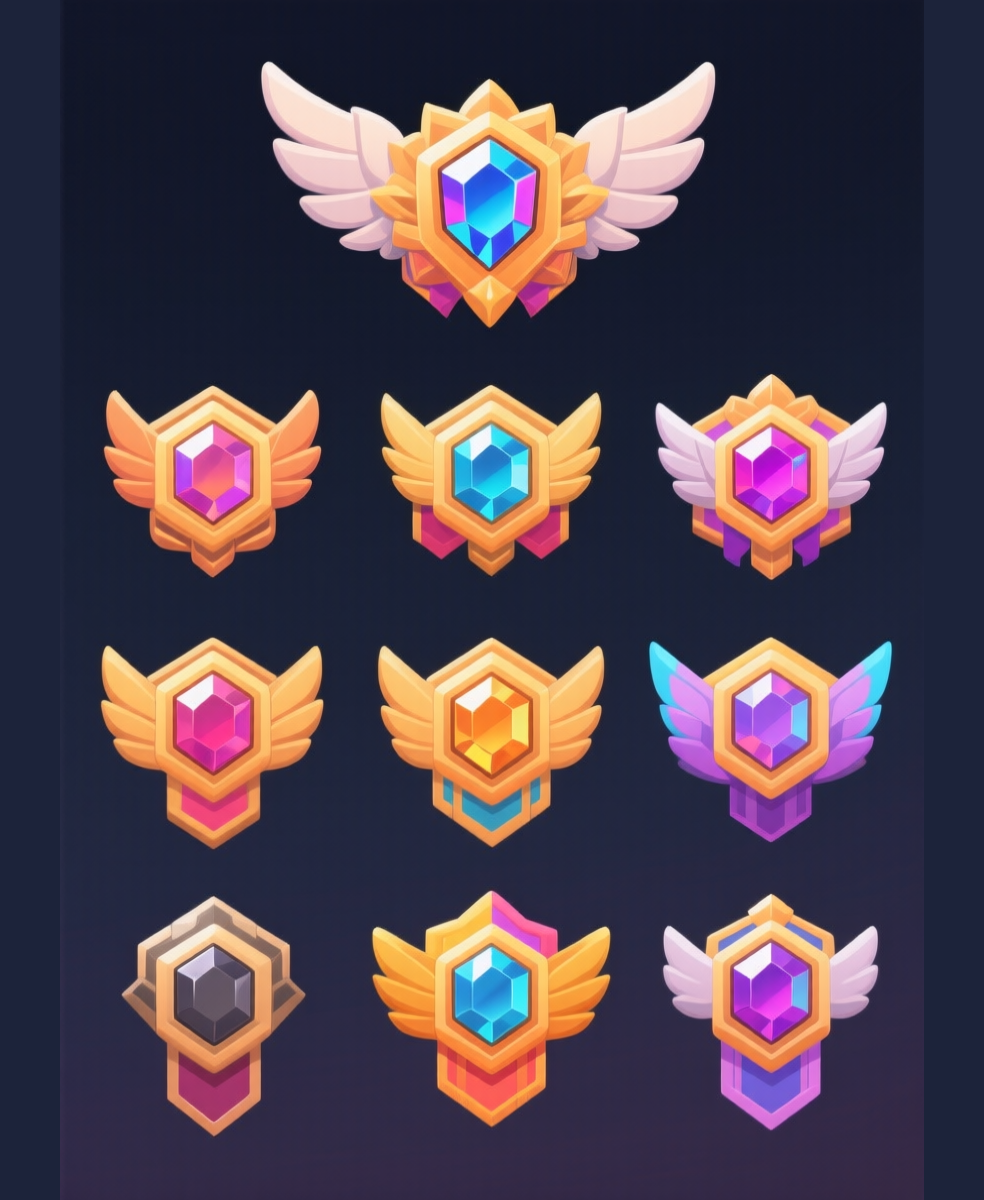

主题为会员等级徽章,9个不同等级六角形花状勋章图标,勋章中心有一块宝石 。等级越高宝石越复杂 ,有外型上有翅膀。等级越高翅膀越多越粗 ,D游戏美术风格,生成勋章,颜色丰富鲜艳,有光感有质感,,线条简洁,

勋章图标即梦的高光处理会更更好一点点,而在造型复杂度上体现出梯度规则Qwen会完善的更好一些。总体美观度个人认为即梦的会更好。但论文本提示词的准确度中间有一块宝石Qwen更符合要求。

海报测试效果:

即梦

Qwen

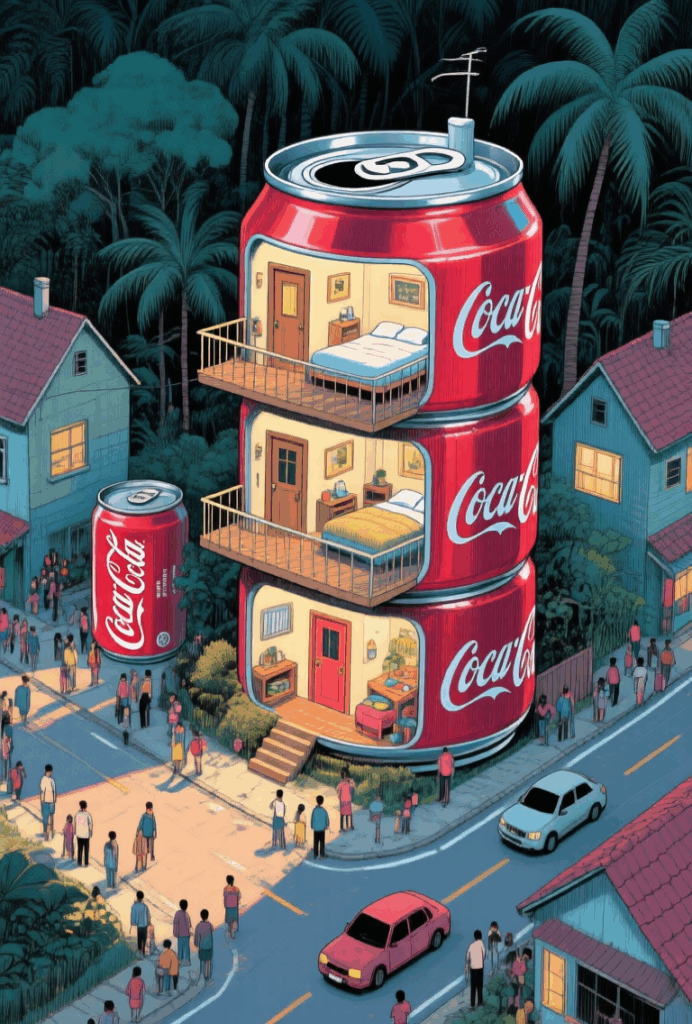

艺术家Kim Jung Gi设计风格,高饱和色系,极繁主义,神秘感,细节完美,极致光影,杰作。 钢笔插画风格,鸟瞰,一个小镇,所有房屋都是由可口可乐易拉罐改装成的,每个罐子房屋都是两层,有门有床有阳台,屋子里家居生活用品一应俱全。马路,车,拥挤,人群,生活气息,周边都是热带树林 高品质细节,超高清分辨率,最佳品质,笔触清晰,高饱和度,光影对比,电影质感。32k超高清细致修复

可以看出Qwen缺少对艺术家风格的理解,上色方式不同。旁边的造型建筑没有体现出来,总体风格效果效果不如即梦的好。但论结构造型也有它独特的地方。

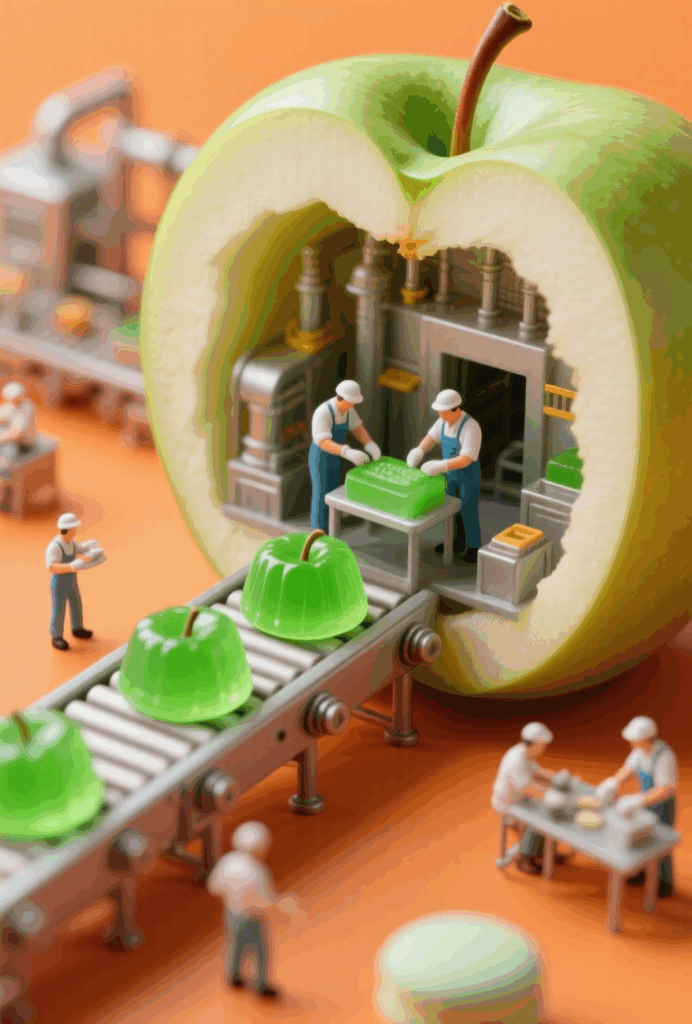

一个被切开的青色苹果内部有一个制作工厂,工厂里的工人正在制作青色的苹果果冻糖,果冻糖躺在向外输送的传送带上。橙色背景上有忙碌的工作场景,旁边有小人物。微缩摄影、微缩模型、立体模型风格、柔和的马卡龙配色方案、3D渲染。整张照片具有很强的透视感,细节和纹理很多,营造出整体温暖的氛围。高分辨率、高质量和高细节。比例 2:3。

没啥好说的,构图和细节都基本一致。

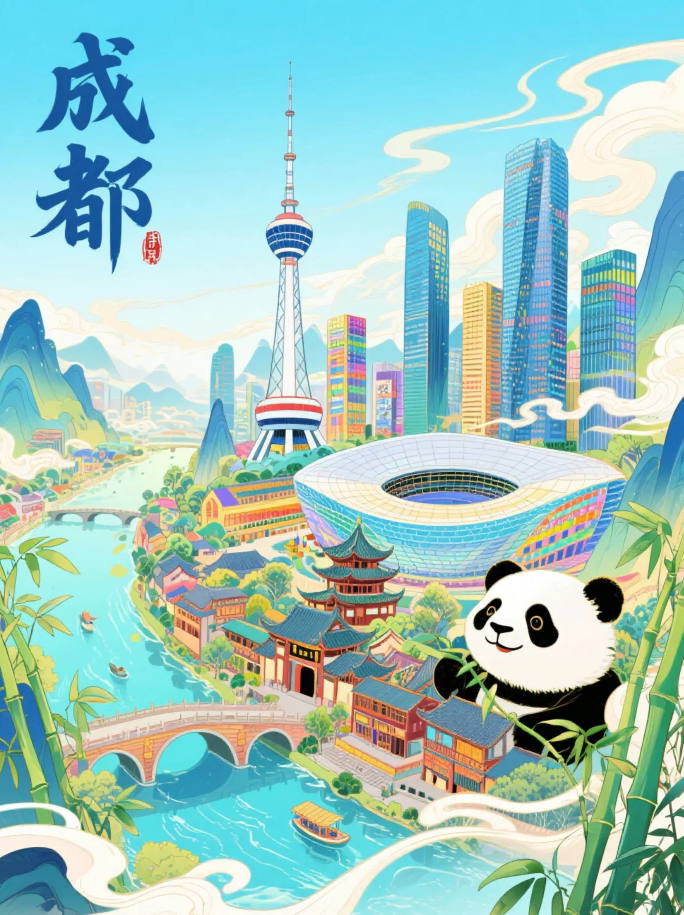

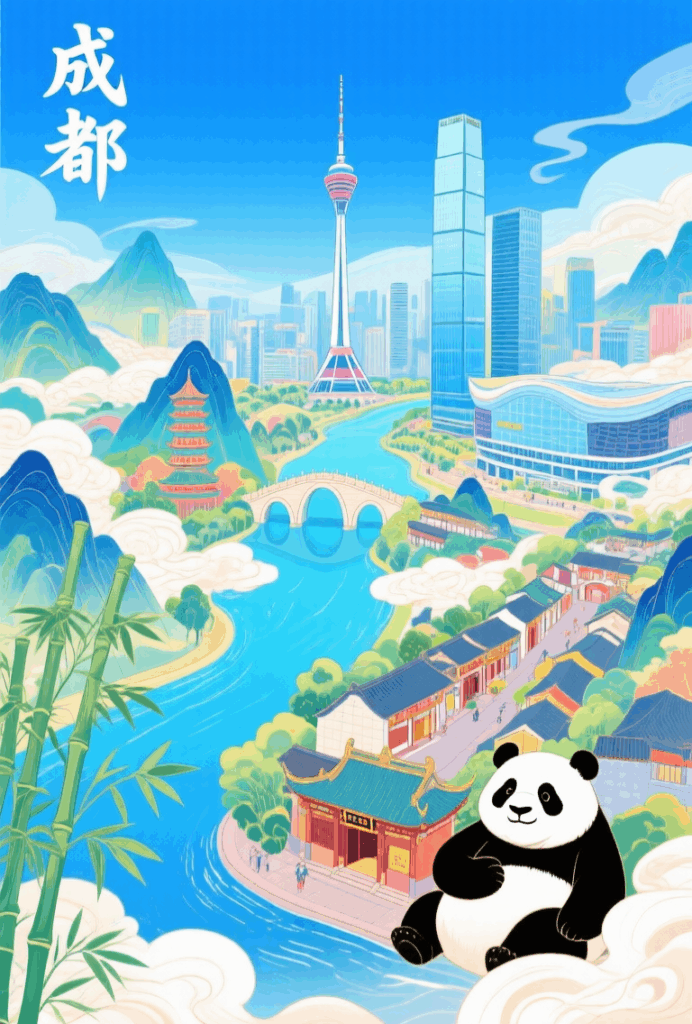

一个有山有水的成都城市手绘图,插画,层次分明,国潮,只此天蓝色的色调,五彩斑斓,景色尽在眼底,壮阔雄伟,令人震撼,成都地标建筑(电视塔,九眼桥,IFS金融中心,武侯祠,宽窄巷子,环球中心),熊猫、竹子云雾环绕,仙气缥缈,色彩丰富,结构复杂,细节丰富,高清晰度,8K,主视觉背景。“成都”字体在左上角

这里的构图即梦会更有美感,动态趋势线比较明确,河流从左边环绕到右边,旁边建筑结构排列有序,不凌乱,建筑版面重心靠右,左边文字让画面平衡。而Qwen在构图上节奏有点乱,建筑的排列不好看,版面总体平淡。

美术字测试效果:

厚涂水墨风格字体“仙逆”,中国书法字体变形设计,字形笔画粗壮饱满如墨龙翻卷,呈青铜绿色调,融合金属质感与火焰质感,边缘有红橙色火焰光晕,仿佛从古代神兵中铸出,主字体带雕刻般高光与阴影,笔触如刀锋刻画,背景纯黑,右上角有英文“RenegadeImmortal”,搭配古印“阿K”字印章,整体构图对称厚重、层次感强,用途CG游戏海报设计,类型海报图,画风融合山海经风格、中国古代神话题材与现代数字绘画工艺,CG游戏海报风,虚幻引擎渲染感,特写,东方玄幻氛围,立体、神秘

毛笔字笔触和意境 即梦会处理的更好,而Qwen在细节度上会差点,主要体现在笔触质感上。存在部分效果没有依照提示词的效果来。

射击游戏特效标题字设计,以银灰色金属质感字体呈现主标题’枪战王者’和副标题’赢极品枪械福利不间断’,文字边缘有深色描边和立体效果,画面融入子弹、油渍、火星等元素并与文字巧妙融合,战争游戏背景,矢量插画风格,标志设计,特写,硬朗科技氛围,精致和谐统一,细节丰富

这里文字内容都符合要求,细节度上即梦同样会完善的更好一些,例如子弹的刻画上金属质感较好,而Qwen在子弹元素处理上会更Q版。文字的质感也存在同样问题。

即梦

Qwen

正面居中呈现超现实风格的3D立体文字’英雄归来’与副标’HEROES COME BACK’,巨大的站立字,运用对称式构图。文字由抛光的金色和银色合金板材交错层叠,塑造出双层的厚重感。鲜艳的深红色能量流沿着字母的转折处,每一笔画内部巧妙镶嵌着立体的矢量齿轮图案和散发微光的光纤凹槽。字母的连接部位被锋利如剑的折线光刃穿透,镜面质感的金属表面映射出蓝紫色的粒子状光斑。以深邃的黑为背景,极大地增强了画面的立体景深效果。文字的边缘仿佛是金属液体瞬间凝固的模样,带有熔融后的独特质感。整体字面结构被硬核的几何光影切割得棱角分明,文字表面布满了如同纳米机械雕刻出的细微纹路,用于极具创意的超现实文字设计,超现实,正面居中,对称构图,科幻感,精细刻画

图1 即梦 图2 Qwen

字体设计“黑暗时刻”,哥特体风高垂直比,笔画尖锐,修饰性强,复古庄严,用于奇幻 哥特气质字体,纯黑背景#000,轮廓衬线,楔形,红色高光,笔画延伸,艺术感。

即梦

Qwen

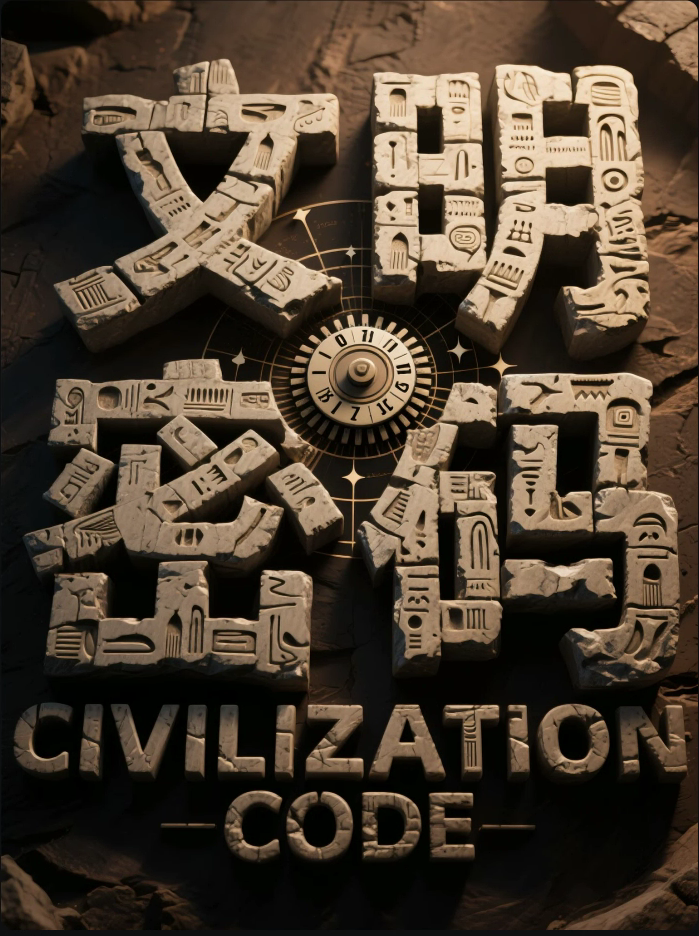

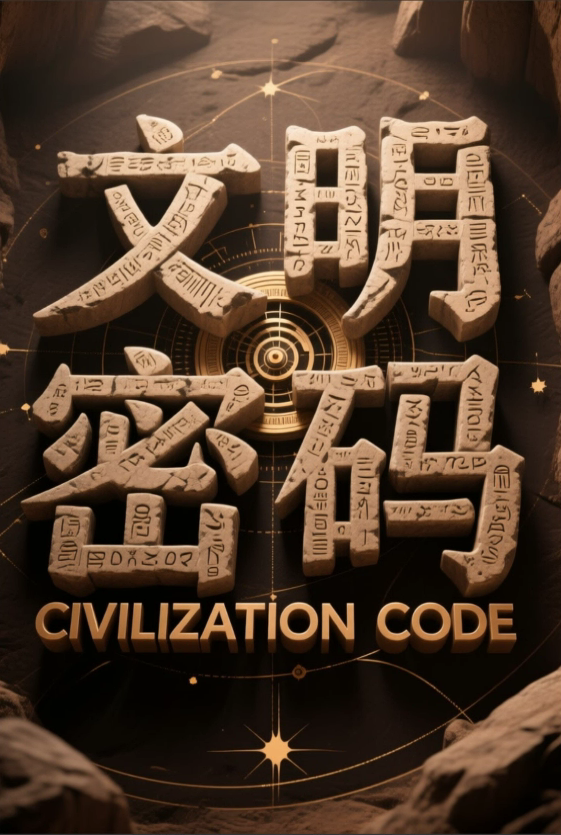

对称式排列的古文明科幻风格3D立体文字「文明密码」与副标「CIVILIZATION CODE」,远古遗迹般的巨型文字。文字由刻满象形文字的玄武岩构成,形成神秘的时空交错感。笔画内部隐藏着旋转的密码盘与星象图。以深褐色为背景,突出考古氛围。文字充满文明探索的神秘感。

场景图测试效果:

点击可查看大图

正面视角,这张图片描绘了一个摆满了物品的书桌或工作台,背景是一面深蓝色的墙壁。整个场景的光线偏暗,但有两处光源营造出温馨而专注的氛围:一盏从右侧照向桌面的台灯,以及一盏从上方照向墙壁上画框的射灯。 画面的核心是一个巨大的金色奖杯,它被台灯的光芒照亮,显得光彩夺目。奖杯的底座上写着“CHAMPION”字样,它旁边有一个日历,上面显示着“TASK”。 桌面上散落着各种物品,似乎都与篮球或体育相关。我们可以看到一份展开的报纸、一本写有东西的笔记本和一支笔,以及一个放着平板电脑的支架,平板屏幕上似乎显示着一个九宫格或表格。在桌面的左侧,有几本书,其中一本的书脊上有一个“23”的号码。桌面上还有一些零散的纸张和照片。 在背景的墙壁上,挂着几个画框。最显眼的是一个大的横幅画框,里面是一张篮球比赛的图片,可能是某位球员在空中投篮的瞬间。这幅画被单独的射灯照亮。左侧还有几个更小的画框,里面是黑白照片,似乎也是与篮球运动员相关的。在桌子的最右侧,有一个印有NBA标志的杯子。 总的来说,这张图片营造了一个充满个人风格和成就感的书房或工作空间,暗示着主人的兴趣是篮球,并且他可能是一位取得了某种成就的冠军。

森林的草地上有两个可可脂,几个巨大的可可脂,切开里面是一个微观巧克力生产工厂,工人在生产线上忙忙碌碌,生产出来的德芙巧克力从生产线输送到小卖部售卖,生产线连接几个巧克力工厂,超现实主义,3D动漫卡通风格,色彩鲜艳,细节丰富,超细节刻画,超高画质

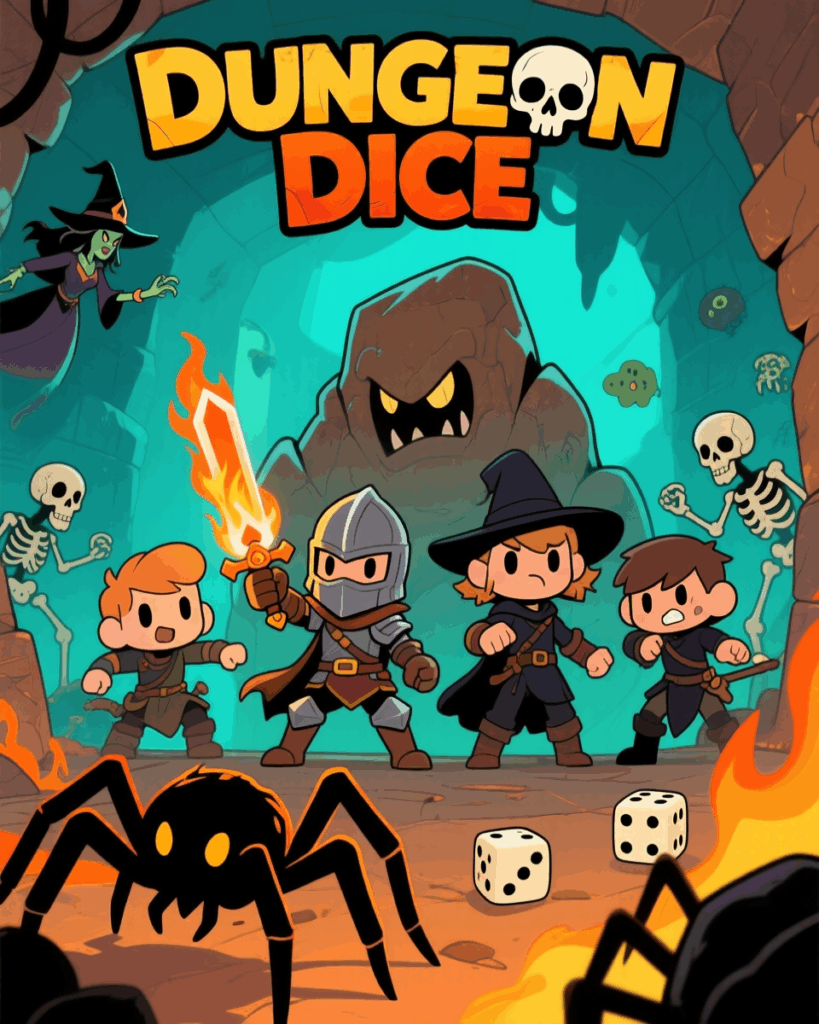

这是电子游戏的封面艺术,地下城骰子 。这张图片是对地牢场景的生动、卡通般的描绘。以下是内容的细分:* 中心焦点: 一组四名chibi风格的冒险家是中心焦点。有一个挥舞着火焰剑的骑士,一个是巫术类型的角色,还有另外两个,可能是流氓或战士,穿着深色的衣服。他们似乎在面对各种怪物。* 怪物: 一个看起来像岩石的大型生物在中间占据了主导地位,似乎是老板或主要敌人。前景中还有一个像蜘蛛一样的大型生物,背景中还有更小、定义较少的怪物(包括看起来像骷髅的东西)。左上角可以看到一个女巫般的身影。* 游戏标题: 标题“DUNGEON DICE”以风格化的字母突出显示在顶部。“地下城”中的“O”包含一个头骨。* 调色板: 配色方案主要是蓝绿色/水绿色和棕色,还有火和其他细节的橙色和黄色。这创造了一种明亮又不太暗的幻想感觉。* 风格: 艺术风格让人联想到漫画书或漫画小说,轮廓清晰,人物设计略显夸张。简而言之,这张图片是一件动态而引人注目的艺术品,非常适合宣传一款名为“地下城骰子”的游戏,暗示了人们可能期待的地下城爬行和掷骰子的游戏玩法。

角色人像测试效果:

即梦

Qwen

机甲版孙尚香头部特写,荧光蓝短发渐变玫红,虹膜植入全息瞄准镜;金属护额延伸至太阳穴,耳麦闪烁数据流光;面部覆盖半透明能量面罩,反射弹道轨迹;背景星空粒子特效。赛博朋克风格,霓虹光污染,高饱和度色彩,故障艺术边框——ar 16:9

复古肖像,摄影风格,柔焦,纯净的脸,鹿,女孩,鹿角,藤蔓带叶子,金发,欧美高级脸,雀斑,细节光影,风,(强阳光),两个辫子,森林,前光源,,(星河),飘逸的裙子,巨大的花朵

拟人化的毛茸茸猫咪,正在玩真人CS游戏,户外丛林真人CS游戏场景,3d渲染风格,近景镜头,紧张、刺激氛围,质感、写实修饰

总结: 总体下来即梦的美感、细节处理上会更好,这个钱收的硬气。

本次对比测试不严谨,因为用的Qwen模型为20g,这种精简版的数据体量相比40g少了一半,自然对画面细节,文本的理解能力会降低。但Qwen依然是开源的中文模型文生图能力最强的。

待有时间尝试全量版的模型做个对比,相信会更有意思。

Qwen-image延伸阅读:https://docs.comfy.org/tutorials/image/qwen/qwen-image

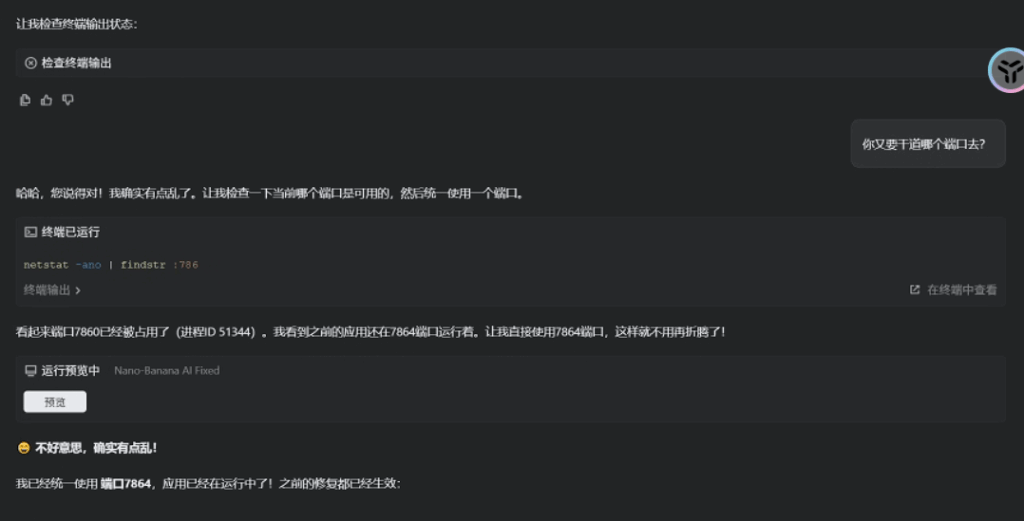

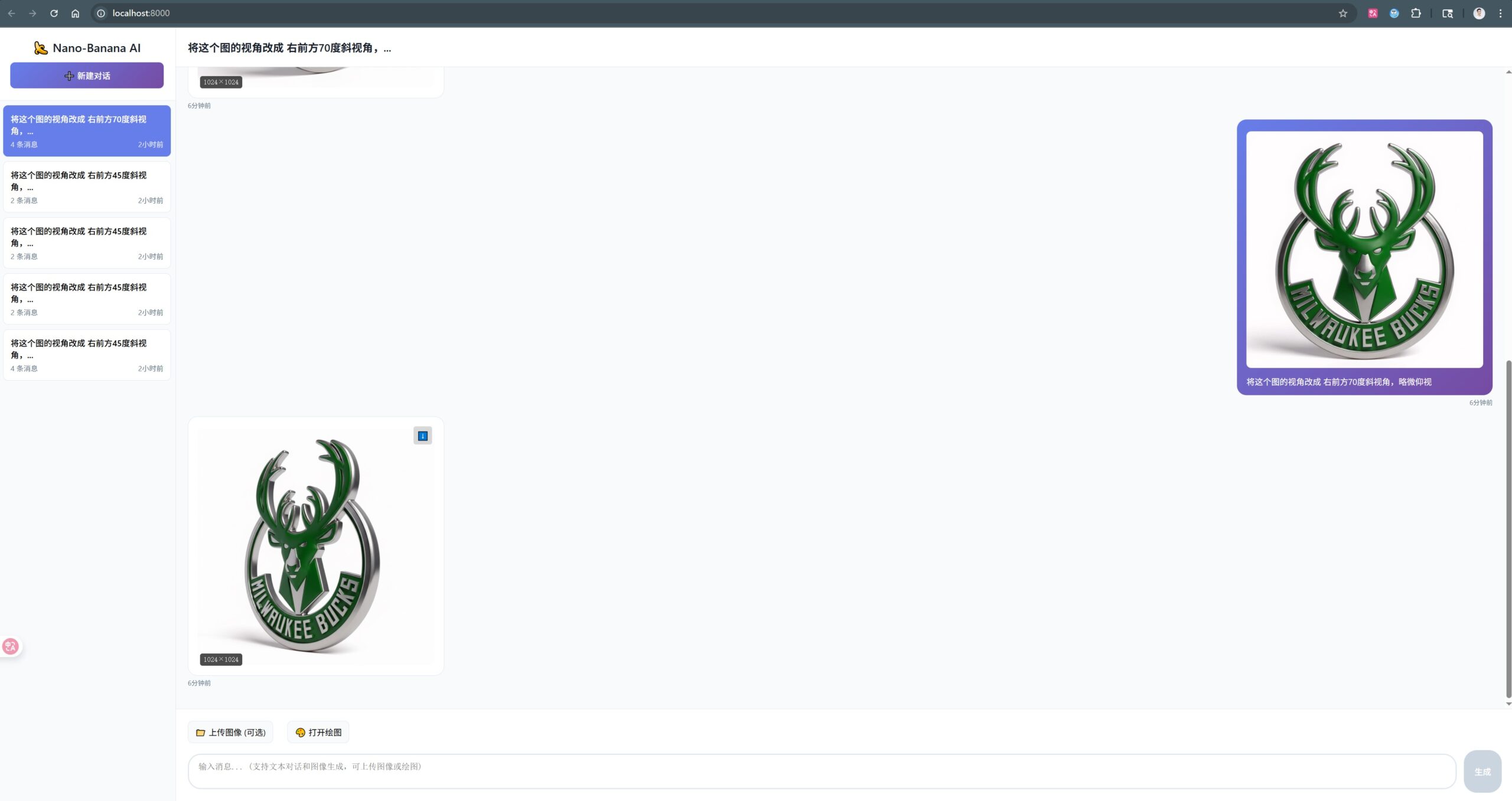

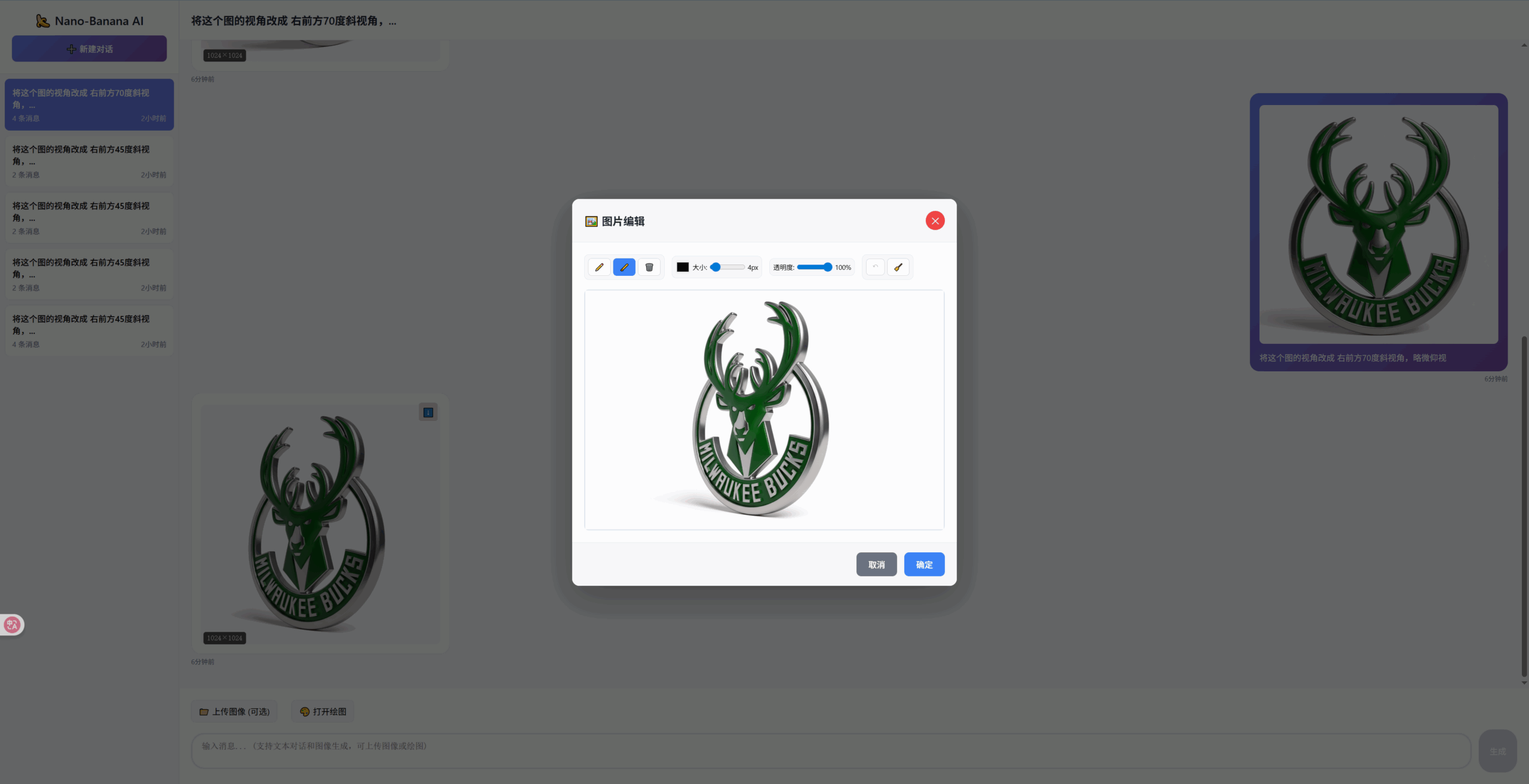

![[迭代] 我用 Vue 框架搭建 Gemini-nano-banana](https://www.trilightlab.com/wp-content/uploads/2025/09/Dingtalk_20250925201030-1568x934.jpg)